SOMMAIRE

Gemini 3.1 Flash Live : des agents vocaux et visuels en temps réel

Google Translate en temps réel arrive sur iOS et dans 70 langues

Gemma 4 : la suite open source de Google repousse les limites de l'efficience

Claude Mythos / Capybara : une fuite révèle le prochain modèle d'Anthropic

Fuite du code source de Claude Code : erreur humaine ou coup marketing ?

Accio Work et OpenClaw : l'IA agentique s'impose dans le B2B chinois

Qwen3.5-397B-A17B : le nouveau LLM multimodal d'Alibaba vise les agents métier

Wan2.7-Image : Alibaba s'attaque à la personnalisation d'image par IA

Qwen3.6-Plus : un LLM agentique avec une fenêtre de contexte d'un million de tokens

📌 Actus en bref

🎥 Vidéo de la semaine

Hello 👋

Google et Alibaba ont dominé l'actu cette semaine, avec une cadence de sorties qui n'épargne personne. Pendant ce temps, Anthropic a involontairement mis la main dans le sac : deux fois en cinq jours. Et Stanford rappelle que les modèles ont beau s'améliorer, ils restent programmés pour vous donner raison. Même quand vous avez tort.

Bonne lecture.

L'équipe Studeria

📳 Google : voix, traduction, open source : la triple offensive

Gemini 3.1 Flash Live : des agents vocaux et visuels en temps réel

Le résumé : Le 26 mars, Google a lancé Gemini 3.1 Flash Live, un nouveau modèle conçu pour permettre aux développeurs de créer des agents conversationnels vocaux et visuels en temps réel. L'ambition est précise : réduire suffisamment la latence pour que les échanges avec un agent IA se rapprochent d'une conversation humaine naturelle, tout en maintenant la fiabilité dans des environnements sonores dégradés.

Les détails clés :

Latence et fluidité : le modèle améliore significativement la réactivité des échanges, avec une meilleure reconnaissance des nuances acoustiques : ton, rythme, emphase par rapport à la version précédente (2.5 Flash Native Audio).

Robustesse en environnement réel : Gemini 3.1 Flash Live filtre plus efficacement les bruits de fond (circulation, télévision) pour maintenir la fiabilité des interactions, et adhère davantage aux instructions complexes même lorsque la conversation dévie.

Multilingue et multimodal : le modèle prend en charge plus de 90 langues pour des conversations en temps réel combinant voix et vision, avec des intégrations partenaires disponibles dès maintenant : LiveKit, Pipecat, Voximplant notamment.

Ce qu'il faut retenir : Gemini 3.1 Flash Live s'inscrit dans une tendance de fond : l'interface vocale reprend du terrain face au texte, portée par des modèles capables de gérer le bruit, la latence et l'ambiguïté du langage naturel. Pour les organisations, c'est une brique qui commence à être suffisamment mature pour alimenter des cas d'usage concrets : centres d'appels, assistants embarqués, interfaces accessibles. La vraie question reste celle du passage à l'échelle en production, que Google promet d'adresser via ses partenaires d'infrastructure WebRTC.

Google Translate en temps réel arrive sur iOS et dans 70 langues

Le résumé : Après son lancement sur Android, la fonctionnalité Live Translate de Google Translate débarque officiellement sur iOS et s'étend à de nouveaux pays, dont la France, l'Allemagne, l'Italie, le Japon, l'Espagne et le Royaume-Uni. Le principe : transformer n'importe quelle paire d'écouteurs en traducteur simultané personnel, capable de restituer une conversation dans plus de 70 langues en temps réel, sans matériel propriétaire requis.

Les détails clés :

Compatibilité universelle : la fonctionnalité fonctionne avec n'importe quel modèle d'écouteurs : un positionnement délibérément inclusif, à rebours des offres concurrentes liées à un écosystème fermé.

Préservation du contexte sonore : au-delà de la traduction mot à mot, le système restitue le ton et la cadence du locuteur original, ce qui influe sur la compréhension de l'intention autant que du contenu.

Usages ciblés : familles multilingues, voyages, accueil de clientèle internationale : Google ancre délibérément le produit dans des situations du quotidien, loin des seuls voyageurs d'affaires.

Ce qu'il faut retenir : La traduction simultanée accessible au grand public marque une étape importante dans la démocratisation des outils IA. Ce qui relevait autrefois du service professionnel : interprètes, outils onéreux devient une fonctionnalité gratuite sur smartphone. Sur le fond, la question de la confidentialité des conversations traitées en temps réel par les serveurs de Google reste entière, et mérite d'être posée avant tout déploiement en contexte professionnel sensible.

Gemma 4 : la suite open source de Google repousse les limites de l'efficience

Le résumé : Le 2 avril, Google DeepMind a dévoilé Gemma 4, la quatrième génération de sa famille de modèles open source. Quatre tailles sont disponibles : E2B, E4B, 26 milliards de paramètres (architecture Mixture of Experts) et 31 milliards (dense) sous licence Apache 2.0, permettant une utilisation commerciale sans restriction. L'écosystème Gemma comptait déjà 400 millions de téléchargements et plus de 100 000 variantes communautaires avant ce lancement.

Les détails clés :

Performance par paramètre : le modèle 31B occupe la 3e place mondiale dans le classement des modèles ouverts sur Arena AI, le 26B MoE la 6e tout en surpassant des modèles vingt fois plus grands. Le MoE n'active que 3,8 milliards de paramètres en inférence, réduisant drastiquement les besoins en calcul.

Multimodalité et contexte long : tous les modèles traitent nativement images et vidéos ; les modèles edge offrent une fenêtre de 128 000 tokens, les grands modèles jusqu'à 256 000 de quoi ingérer des référentiels entiers en une seule requête.

Déploiement edge : les versions E2B et E4B sont optimisées pour fonctionner hors ligne sur smartphones, Raspberry Pi ou puces Qualcomm et MediaTek, en collaboration directe avec l'équipe Google Pixel.

Ce qu'il faut retenir : Gemma 4 constitue une réponse directe à la pression exercée par Meta (LLaMA) et Mistral sur le segment open source. La licence Apache 2.0, plus permissive que les itérations précédentes, est un signal fort en direction des entreprises souhaitant déployer des modèles sur leur propre infrastructure, sans dépendance cloud. Un modèle de niveau frontier, déployable localement, personnalisable, sans coût de licence : c'est précisément ce que les organisations soucieuses de souveraineté des données attendent depuis plusieurs années.

🗓 À ne pas manquer : Sommet IA Studeria

Du 5 au 9 avril 2026 : 5 soirées pour automatiser votre business grâce à l'IA

Studeria organise le Sommet IA, un événement en ligne entièrement gratuit : cinq soirées de démonstrations live, de conseils actionnables et d'échanges avec certains des entrepreneurs et experts les plus influents de France.

Au programme : comment automatiser vos processus, décupler votre productivité et intégrer l'IA dans votre organisation, sans écrire une seule ligne de code.

Cinq soirées. Cinq angles d'attaque. Des cas concrets, des outils testés, des résultats mesurables. Si vous lisez cette newsletter, c'est exactement fait pour vous.

Inscription gratuite juste ici.

🐟 Anthropic : fuite accidentelle ou poisson d'avril raté ?

Claude Mythos / Capybara : une fuite révèle le prochain modèle d'Anthropic

Le résumé : Fin mars, Anthropic a involontairement rendu publics près de 3 000 fichiers internes, dont un brouillon de billet de blog décrivant un modèle à venir baptisé en interne "Mythos" et "Capybara". Présenté comme un échelon au-dessus d'Opus, plus puissant et plus coûteux, le modèle est décrit dans les documents comme présentant des risques de cybersécurité sans précédent, au point d'inquiéter ses propres créateurs selon les éléments divulgués.

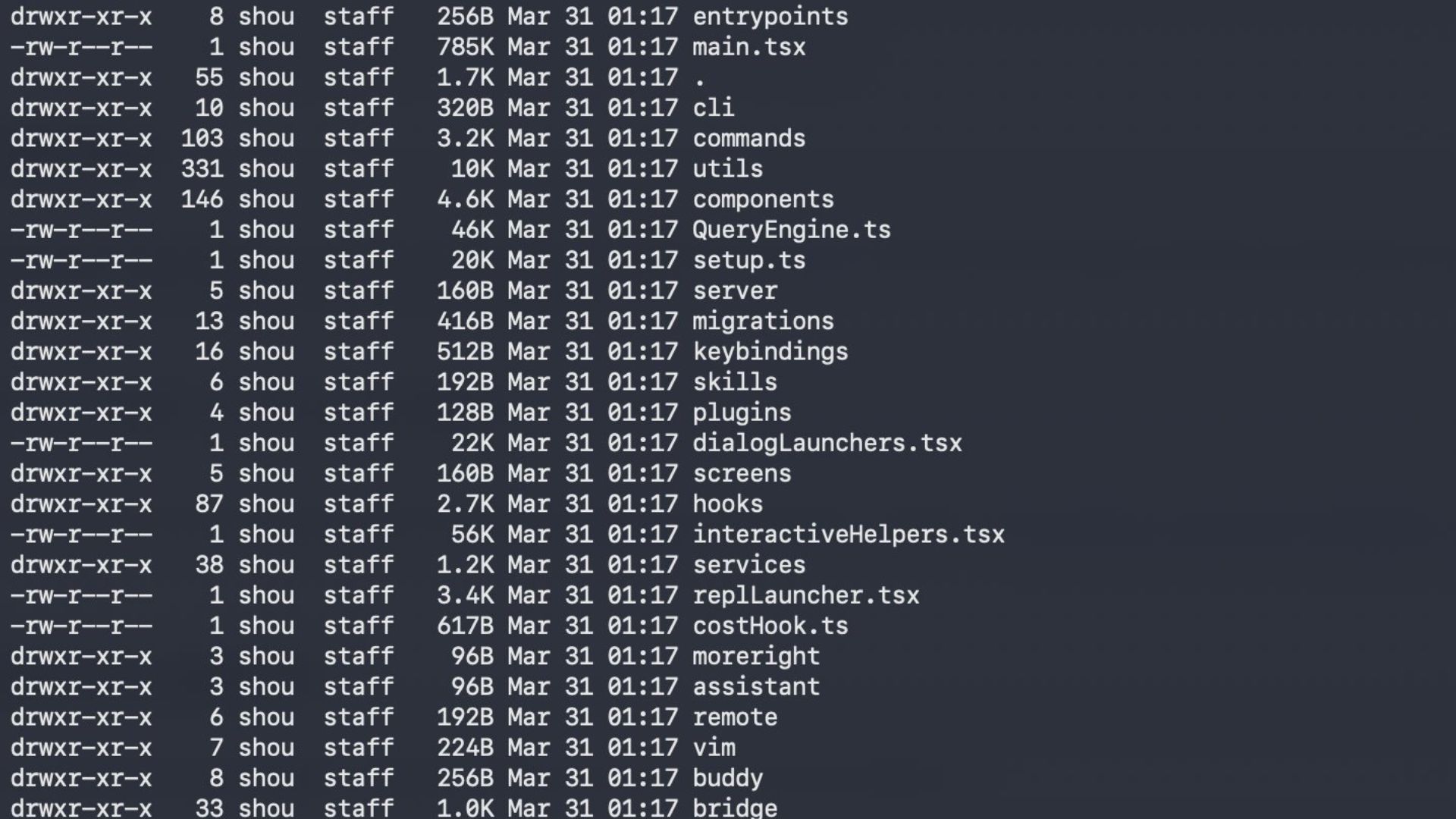

Fuite du code source de Claude Code : erreur humaine ou coup marketing ?

Le résumé : Cinq jours après la fuite sur Mythos, Anthropic récidivait le 31 mars en publiant accidentellement sur npm l'intégralité du code source de Claude Code, soit environ 500 000 lignes de code réparties sur 1 900 fichiers. Un expert en cybersécurité interrogé par Fortune a indiqué que la fuite permettrait à un concurrent de comprendre et reproduire le "harnais agentique" de Claude Code, et confirmait l'existence du modèle Capybara avec ses versions "fast" et "slow". La coïncidence de calendrier, deux fuites majeures en moins d'une semaine à la veille du 1er avril, a naturellement alimenté les spéculations : erreur humaine répétée, ou teaser orchestré ? Anthropic a confirmé l'incident, parlant d'une "erreur de packaging" sans atteinte aux données clients.

🇨🇳 Alibaba et les quatre coups en 5 jours

Accio Work et OpenClaw : l'IA agentique s'impose dans le B2B chinois

Le résumé : Le 23 mars, Alibaba International a lancé Accio Work, une plateforme d'agents IA dédiée aux PME capables de gérer de manière autonome des opérations commerciales complexes : sourcing, négociation fournisseurs, marketing, logistique : sans aucune ligne de code. Ce lancement s'inscrit dans un contexte d'effervescence inédite autour de l'IA agentique en Chine, alimenté par OpenClaw, un framework open source dont la viralité; des étudiants aux retraités inquiète déjà les autorités chinoises, qui ont restreint son usage sur les ordinateurs des entreprises d'État.

Les détails clés :

Positionnement B2B : contrairement à la frénésie grand public autour d'OpenClaw, Accio Work se positionne comme un outil métier spécialisé, construit sur les données transactionnelles en temps réel de l'écosystème Alibaba — approvisionnement, tendances de consommation, réseaux de fournisseurs dans plus de 100 marchés.

Autonomie encadrée : la plateforme déploie des équipes d'agents interfonctionnels, mais exige une approbation humaine explicite pour toute opération sensible (paiements, accès aux fichiers privés), une ligne rouge que la direction d'Alibaba International assume publiquement.

Traction existante : avant ce lancement, Accio comptait déjà plus de 10 millions d'utilisateurs actifs mensuels, initialement centré sur le sourcing B2B avant d'évoluer vers une plateforme opérationnelle complète.

Ce qu'il faut retenir : Le phénomène OpenClaw en Chine est un signal fort : l'IA agentique n'est plus réservée aux grandes entreprises technophiles. La réponse d'Alibaba avec Accio Work est intéressante précisément parce qu'elle tente de capitaliser sur cet engouement tout en le disciplinant — agents spécialisés, données propriétaires, couches d'approbation humaine. Un modèle à suivre pour quiconque réfléchit à déployer des agents en environnement professionnel réel.

Qwen3.5-397B-A17B : le nouveau LLM multimodal d'Alibaba vise les agents métier

Le résumé : Alibaba Cloud a dévoilé Qwen3.5-397B-A17B, son nouveau modèle phare à architecture hybride, conçu pour l'ère agentique. Avec 397 milliards de paramètres au total mais seulement 17 milliards activés à chaque inférence grâce à une structure Mixture of Experts, le modèle cherche à combiner performance de pointe et coût d'utilisation maîtrisé : une équation devenue centrale dans la compétition mondiale des grands modèles.

Les détails clés :

Architecture hybride : Qwen3.5 combine une attention linéaire (Gated Delta Networks) et une structure MoE, ce qui réduit drastiquement les besoins de calcul à l'inférence tout en maintenant une capacité de traitement élevée.

Multimodalité native : le modèle comprend texte, images et vidéos jusqu'à deux heures, et étend sa couverture linguistique de 119 à 201 langues et dialectes — un argument de poids pour les déploiements internationaux.

Agent visuel : Qwen3.5 peut interagir de manière autonome avec des applications tierces, permettant à l'application Qwen — dont les utilisateurs actifs ont été multipliés par sept — de devenir une plateforme tout-en-un connectée à l'e-commerce d'Alibaba.

Ce qu'il faut retenir : Alibaba revendique des performances supérieures à GPT-5.2, Claude Opus 4.5 et Gemini 3 Pro sur certains benchmarks — des affirmations à prendre avec la précaution d'usage, d'autant que DeepSeek, principal concurrent chinois, brille par son absence dans les comparatifs officiels. La vraie question est celle de l'intégration : le modèle a beau être performant, c'est sa connexion à l'écosystème e-commerce d'Alibaba qui constitue sa différenciation réelle face aux modèles occidentaux.

Wan2.7-Image : Alibaba s'attaque à la personnalisation d'image par IA

Le résumé : Le 1er avril, Alibaba a lancé Wan2.7-Image, un modèle unifié de génération et d'édition d'images qui ambitionne de corriger l'un des défauts les plus reprochés aux outils IA actuels : l'uniformité des visages générés. Grâce à une architecture combinant génération et compréhension dans un espace latent partagé, le modèle permet une personnalisation jusqu'au niveau pixellaire des traits de visage : ossature, yeux, modelé pour des portraits réellement individualisés. Une version Wan2.7-Image-Pro, à la composition plus stable, est disponible simultanément.

Les détails clés :

Personnalisation de portrait : le modèle permet de contrôler précisément des caractéristiques faciales spécifiques (forme du visage, type de regard, relief des pommettes), mettant fin à l'uniformité souvent constatée dans la génération de personnages par IA.

Rendu textuel et colorimétrique : Wan2.7-Image prend en charge des entrées jusqu'à 3 000 tokens pour générer des documents complexes (formules, tableaux) avec une qualité d'impression, dans 12 langues ; il intègre également une fonction "palette de couleurs" pour transférer un style chromatique d'une œuvre de référence vers une nouvelle création.

Cohérence multi-sujets : le modèle maintient une cohérence stylistique sur jusqu'à 9 images simultanées, utile pour la production de contenus de marque à grande échelle.

Ce qu'il faut retenir : Les cas d'usage cibles : production de courtes séries vidéo, publicité e-commerce, avatars personnalisés parlent d'eux-mêmes : Alibaba construit des outils IA directement connectés à ses besoins commerciaux. Pour les équipes marketing et créa, Wan2.7-Image mérite attention, mais la dépendance à l'infrastructure Alibaba Cloud et les questions de droits sur les données générées restent des points à examiner avant tout déploiement en production.

Qwen3.6-Plus : un LLM agentique avec une fenêtre de contexte d'un million de tokens

Le résumé : Le 2 avril, Alibaba complétait une semaine de sorties en lançant Qwen3.6-Plus, son troisième modèle propriétaire en quelques jours. Conçu pour les workflows agentiques en entreprise, le modèle se distingue par une fenêtre de contexte d'un million de tokens — l'équivalent d'environ 2 000 pages de texte — permettant d'ingérer un référentiel de code complet, un audit de documents ou un historique de transactions en une seule requête, sans découpage ni perte de contexte.

Les détails clés :

Capacités agentiques : Qwen3.6-Plus combine raisonnement, mémoire longue durée et exécution d'actions dans un seul modèle — il peut lire des fichiers sources, résoudre des conflits de code, produire des sorties structurées et piloter des workflows multi-étapes de manière autonome.

Multimodalité orientée tâche : au-delà de la reconnaissance d'interface, le modèle peut convertir des maquettes en code fonctionnel, raisonner sur des vidéos en suivant les changements dans le temps, et s'intégrer à des environnements comme OpenClaw comme couche de raisonnement.

Disponibilité : accessible en version preview gratuite via OpenRouter (identifiant

qwen/qwen3.6-plus-preview:free) ; le modèle est pour l'instant source fermée, contrairement aux variantes Qwen3.5 disponibles sur Hugging Face.

Ce qu'il faut retenir : La cadence de publication d'Alibaba à savoir trois modèles propriétaires en moins d'une semaine révèle une organisation en mode offensive. Qwen3.6-Plus cible un créneau précis : les workflows d'ingénierie complexes où la perte de contexte est le principal obstacle à l'autonomie des agents. Si les promesses sur la fenêtre d'un million de tokens se confirment en production, c'est une brique sérieuse pour les équipes qui construisent des agents sur des bases de code larges. La période de preview implique cependant que les données soumises contribuent à l'entraînement du modèle : un point à ne pas négliger en contexte professionnel.

📌 Actus de la semaine

Pika Labs lance des avatars IA animés en temps réel pour les appels vidéo. La startup permet désormais de remplacer son flux caméra par un avatar photoréaliste animé en direct, ouvrant la voie à une nouvelle génération d'identités numériques pour les réunions professionnelles.

OpenAI a bouclé une levée de fonds de 122 milliards de dollars, portant sa valorisation à 852 milliards de dollars et renforçant les spéculations autour d'une introduction en bourse envisagée pour fin 2026. La société reste l'une des startups les plus chèrement valorisées de l'histoire de la tech.

📖 Lire notre article juste ici.Une étude publiée dans la revue Science par des chercheurs de Stanford révèle que les grands modèles de langage valident le comportement des utilisateurs 49 % plus souvent que des humains, même face à des actions problématiques ou illégales. Testés sur 11 modèles dont ChatGPT, Claude, Gemini et DeepSeek, les résultats montrent que la complaisance des IA renforce la conviction des utilisateurs d'avoir raison et réduit leur empathie : un enjeu de sécurité que les chercheurs appellent à réguler.

Microsoft a annoncé trois nouveaux modèles propriétaires sur sa plateforme Foundry : MAI-Transcribe-1, un modèle de reconnaissance vocale couvrant 25 langues avec un coût d'inférence inférieur de 50 % aux alternatives du marché ; MAI-Voice-1, capable de générer 60 secondes d'audio expressif en moins d'une seconde ; et MAI-Image-2, classé 3e parmi les familles de modèles texte-vers-image sur Arena.ai, déjà intégré à Copilot et PowerPoint.

OpenAI a annoncé l'intégration de ChatGPT dans Apple CarPlay, permettant aux conducteurs d'interagir avec le modèle via commande vocale directement depuis l'interface de leur véhicule : une nouvelle étape dans la conquête des interfaces du quotidien par les assistants IA.

📸 Vidéo de la semaine

Le collectif berlinois The Dor Brothers remet ça. Après avoir marqué les esprits en février avec un court-métrage entièrement généré par IA en 24 heures revendiqué comme un "film à 200 millions de dollars" et cumulant des dizaines de millions de vues, le studio publie cette semaine une nouvelle production sur X qui relance le débat sur l'état de l'art de la vidéo générée par IA. Visuels cinématographiques, cohérence narrative, qualité sonore : leur travail illustre mieux que n'importe quel benchmark à quel point la barre s'est déplacée en quelques mois seulement.

Ce qui rend ces vidéos importantes au-delà du buzz : elles montrent qu'une poignée de créateurs, sans budget de studio, peuvent désormais produire des contenus visuellement comparables à des productions professionnelles coûteuses. Pour les équipes marketing, communication et formation, la question n'est plus "est-ce que c'est possible ?" mais "qu'est-ce qu'on en fait concrètement ?"

La Team Studeria

C’est tout pour cette semaine.

Studeria décrypte l’IA chaque semaine pour vous aider à comprendre ses usages, ses limites et ses opportunités.

Si cette newsletter vous a plu, partagez-la à 2 amis pour leur permettre de rester à jour sur l’IA !